Для кабелів BMS, BUS, промислових, інструментальних.

Ілон Маск та команда xAI офіційно запустили останню версію Grok, Grok3, під час прямої трансляції. Перед цією подією значна кількість пов'язаної інформації, разом із цілодобовим рекламним ажіотажем Маска, підняли світові очікування щодо Grok3 до безпрецедентного рівня. Всього тиждень тому Маск впевнено заявив під час прямої трансляції, коментуючи DeepSeek R1: «xAI ось-ось запустить кращу модель штучного інтелекту». Згідно з даними, представленими в прямому ефірі, Grok3, як повідомляється, перевершив усі сучасні основні моделі за показниками математики, науки та програмування, причому Маск навіть стверджував, що Grok3 буде використовуватися для обчислювальних завдань, пов'язаних з місіями SpaceX на Марс, передбачивши «прориви на рівні Нобелівської премії протягом трьох років». Однак наразі це лише твердження Маска. Після запуску я протестував останню бета-версію Grok3 і поставив класичне запитання з підступом для великих моделей: «Що більше, 9,11 чи 9,9?» На жаль, без будь-яких кваліфікаторів чи позначень так званий найрозумніший Grok3 все ще не зміг правильно відповісти на це запитання. Grok3 не зміг точно визначити значення питання.

Цей тест швидко привернув значну увагу багатьох друзів, і, за збігом обставин, різні подібні тести за кордоном показали, що Grok3 має труднощі з базовими питаннями з фізики/матеми, такими як «Яка куля першою падає з Пізанської вежі?». Тому його жартома назвали «генієм, який не бажає відповідати на прості запитання».

Grok3 хороший, але не кращий за R1 чи o1-Pro.

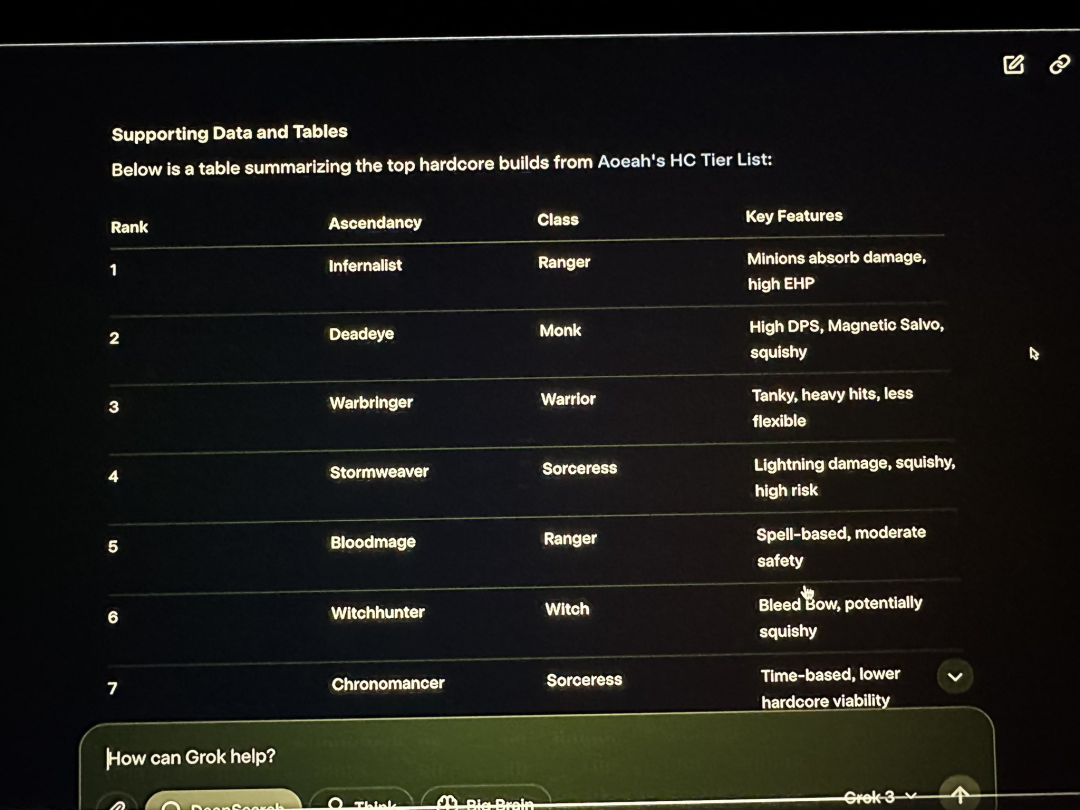

Grok3 зазнав «провалів» у багатьох тестах на загальні знання на практиці. Під час запуску xAI Маск продемонстрував використання Grok3 для аналізу класів персонажів та ефектів з гри Path of Exile 2, в яку, як він стверджував, часто грає, але більшість відповідей, наданих Grok3, були неправильними. Маск під час прямої трансляції не помітив цієї очевидної проблеми.

Ця помилка не лише стала черговим доказом для закордонних користувачів мережі, щоб насміхатися з Маска за те, що він «знайшов заміну» в іграх, але й викликала значні занепокоєння щодо надійності Grok3 у практичному застосуванні. Для такого «генія», незалежно від його фактичних можливостей, його надійність у надзвичайно складних сценаріях застосування, таких як завдання дослідження Марса, залишається під сумнівом.

Наразі багато тестувальників, які отримали доступ до Grok3 кілька тижнів тому, і ті, хто лише вчора кілька годин тестував можливості моделі, вказують на спільний висновок: «Grok3 хороший, але він не кращий за R1 чи o1-Pro».

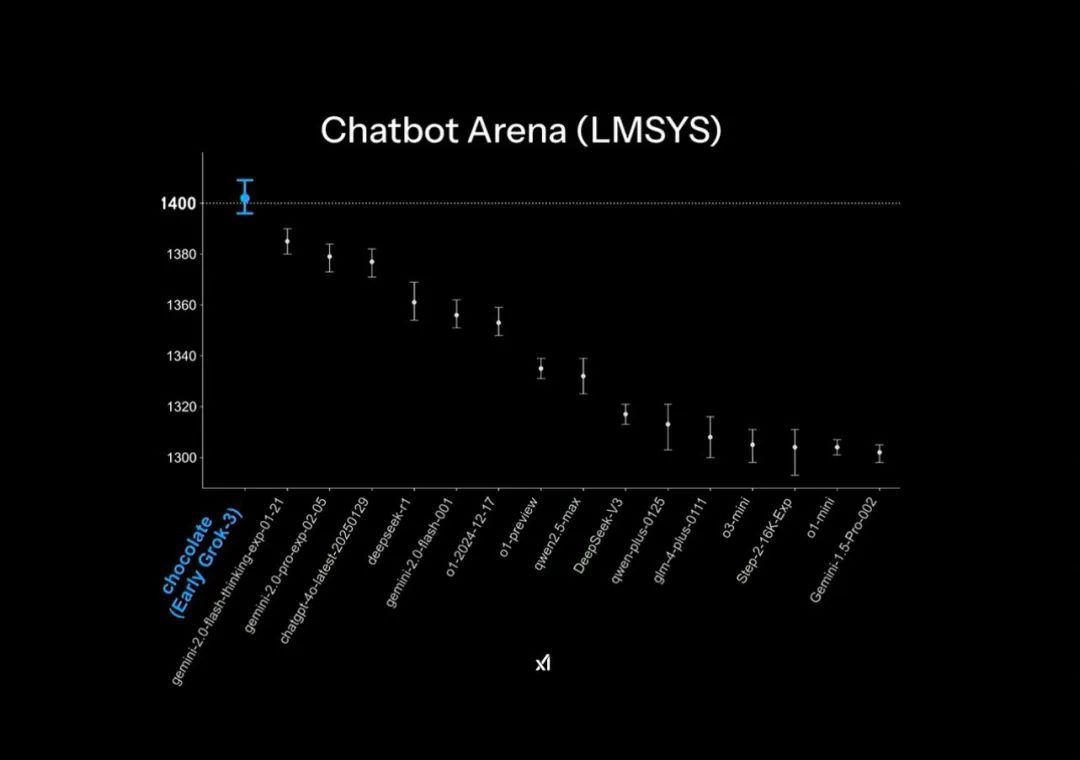

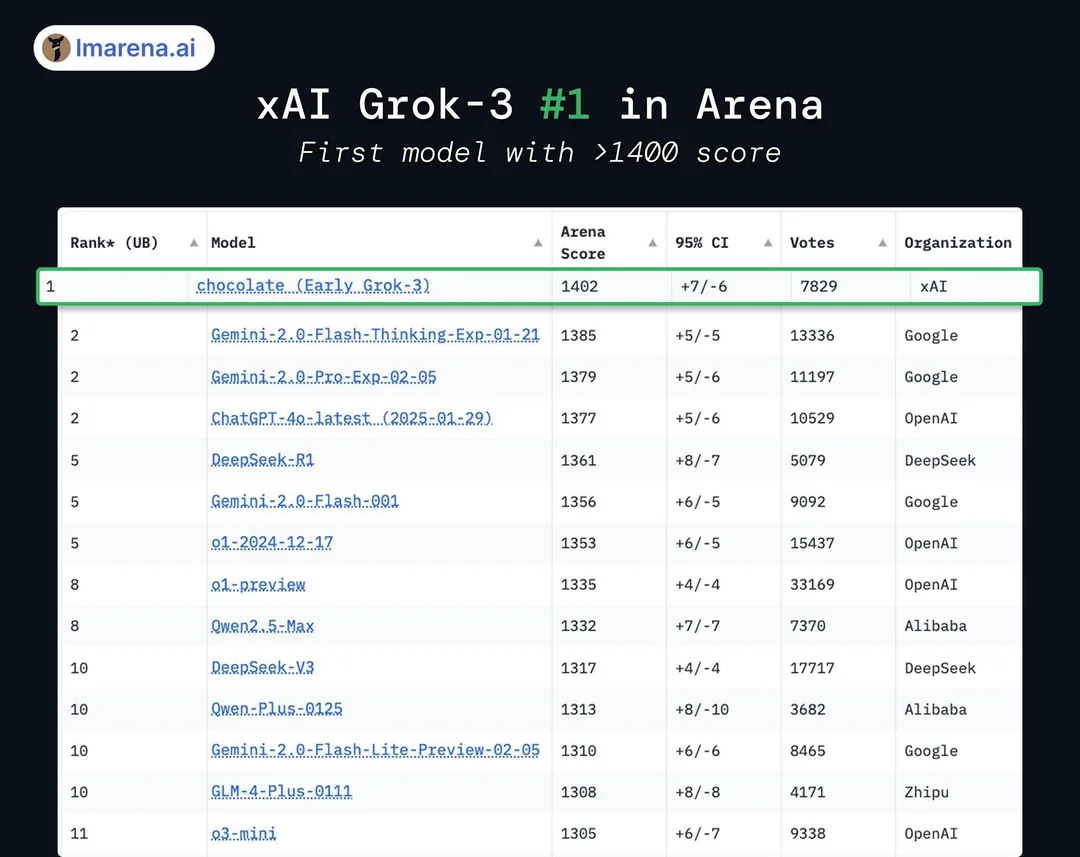

Критичний погляд на "зрив Nvidia"

У офіційно представленій презентації PPT під час релізу було показано, що Grok3 «значно випереджає» на Арені чат-ботів, але для цього було використано вміло графічні прийоми: вертикальна вісь на таблиці лідерів відображала лише результати в діапазоні балів 1400-1300, що робить початкову різницю в результатах тестування в 1% надзвичайно значною в цій презентації.

У фактичних результатах оцінювання моделей Grok3 випереджає DeepSeek R1 та GPT-4.0 лише на 1-2%, що відповідає досвіду багатьох користувачів у практичних тестах, які не виявили «помітної різниці». Grok3 перевершує своїх наступників лише на 1-2%.

Хоча Grok3 отримав вищі бали, ніж усі публічно протестовані наразі моделі, багато хто не сприймає це серйозно: зрештою, xAI раніше критикували за «маніпуляцію балами» в еру Grok2. Оскільки таблиця лідерів карала стиль довжини відповідей, бали значно знизилися, що спонукало інсайдерів галузі часто критикувати феномен «високих балів, але низьких здібностей».

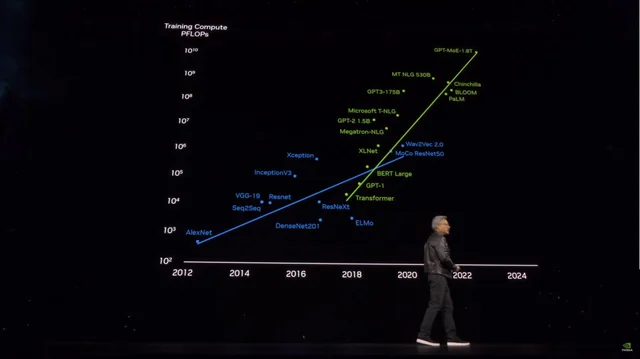

Чи то через «маніпуляції» з таблицею лідерів, чи то дизайнерські хитрощі в ілюстраціях, вони розкривають одержимість xAI та Маска ідеєю «лідерства» в можливостях моделей. Маск заплатив високу ціну за ці переваги: під час запуску він похвалився використанням 200 000 графічних процесорів H100 (стверджуючи, що «понад 100 000» під час прямої трансляції) та досягненням загального часу навчання 200 мільйонів годин. Це змусило деяких повірити, що це є ще одним значним благом для індустрії графічних процесорів, а вплив DeepSeek на цей сектор вважати «дурним». Примітно, що деякі вважають, що майбутнє навчання моделей буде за обчислювальною потужністю.

Однак деякі користувачі мережі порівняли споживання енергії 2000 графічних процесорів H800 протягом двох місяців для створення DeepSeek V3, підрахувавши, що фактичне споживання енергії Grok3 під час навчання в 263 рази більше, ніж V3. Різниця між DeepSeek V3, який набрав 1402 бали, та Grok3 становить трохи менше 100 балів. Після публікації цих даних багато хто швидко зрозумів, що за титулом Grok3 як «найсильнішого у світі» криється явний ефект граничної корисності — логіка того, що більші моделі, що генерують вищу продуктивність, почала демонструвати зменшення віддачі.

Навіть з «високим балом, але низькою здатністю», Grok2 мав величезну кількість високоякісних даних власного виробництва з платформи X (Twitter) для підтримки використання. Однак під час навчання Grok3 xAI природно зіткнувся з «стелею», з якою зараз стикається OpenAI — відсутність преміальних навчальних даних швидко виявляє граничну корисність можливостей моделі.

Розробники Grok3 та Маск, ймовірно, першими зрозуміють та глибоко визначать ці факти, саме тому Маск постійно згадує в соціальних мережах, що версія, з якою користувачі стикаються зараз, «все ще є лише бета-версією», а «повна версія вийде в найближчі місяці». Маск взяв на себе роль менеджера продукту Grok3, пропонуючи користувачам залишати відгуки щодо різних проблем, що виникають, у розділі коментарів. Він може бути найпопулярнішим менеджером продукту на Землі.

Однак, протягом дня продуктивність Grok3, безсумнівно, викликала тривогу у тих, хто сподівається покластися на «масивну обчислювальну потужність» для навчання сильніших великих моделей: згідно з загальнодоступною інформацією Microsoft, розмір параметрів GPT-4 OpenAI становить 1,8 трильйона параметрів, що більш ніж у десять разів перевищує розмір параметрів GPT-3. Чутки свідчать про те, що розмір параметрів GPT-4.5 може бути ще більшим.

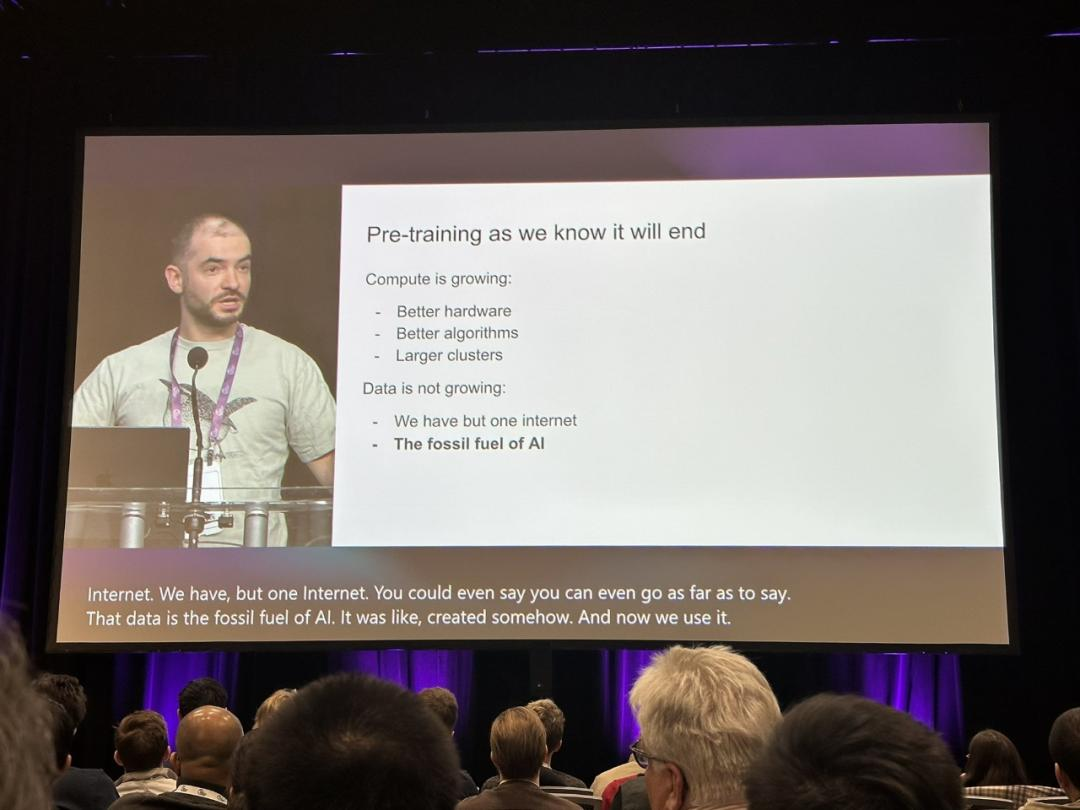

Зі зростанням розмірів параметрів моделі стрімко зростають витрати на навчання. З появою Grok3, такі претенденти, як GPT-4.5 та інші, які бажають продовжувати «витрачати гроші» на досягнення кращої продуктивності моделі за рахунок розміру параметрів, повинні враховувати межу, яка зараз чітко видна, та обміркувати, як її подолати. Наразі Ілля Суцкевер, колишній головний науковий співробітник OpenAI, раніше заявив у грудні минулого року: «Попереднє навчання, з яким ми звикли, закінчиться», що знову спливло в дискусіях, спонукаючи до зусиль знайти справжній шлях для навчання великих моделей.

Точка зору Іллі викликала тривогу в галузі. Він точно передбачив неминуче вичерпання доступних нових даних, що призведе до ситуації, коли продуктивність не зможе продовжувати підвищуватися шляхом збору даних, порівнявши це з вичерпанням викопного палива. Він зазначив, що «як і нафта, контент, створений людиною, в Інтернеті є обмеженим ресурсом». За прогнозами Суцкевера, наступне покоління моделей, після попереднього навчання, матиме «справжню автономію» та можливості міркування, «подібні до людського мозку».

На відміну від сучасних попередньо навчених моделей, які переважно покладаються на зіставлення контенту (на основі раніше вивченого контенту моделі), майбутні системи штучного інтелекту зможуть навчатися та встановлювати методології для вирішення проблем у спосіб, подібний до «мислення» людського мозку. Людина може досягти фундаментальної майстерності в певній галузі, маючи лише базову професійну літературу, тоді як велика модель штучного інтелекту потребує мільйонів точок даних для досягнення лише найбазовішої ефективності початкового рівня. Навіть якщо формулювання незначно змінити, ці фундаментальні питання можуть бути неправильно зрозумілі, що ілюструє, що модель насправді не покращила інтелект: основні, але нерозв'язні питання, згадані на початку статті, є яскравим прикладом цього явища.

Висновок

Однак, окрім грубої сили, якщо Grok3 справді вдасться розкрити галузі, що «попередньо навчені моделі наближаються до свого кінця», це матиме значні наслідки для цієї галузі.

Можливо, після того, як шаленство навколо Grok3 поступово вщухне, ми станемо свідками більшої кількості випадків, подібних до прикладу Фей-Фей Лі про «налаштування високопродуктивних моделей на певному наборі даних лише за 50 доларів», що зрештою відкриває справжній шлях до ЗШІ.

Контрольні кабелі

Структурована кабельна система

Мережа та дані, оптоволоконний кабель, патч-корд, модулі, лицьова панель

16-18 квітня 2024 року. Енергетична виставка Близького Сходу в Дубаї.

16-18 квітня 2024 року, Securika в Москві

9 травня 2024 року в Шанхаї відбувся запуск нових продуктів і технологій

22-25 жовтня 2024 року, SECURITY CHINA у Пекіні

19-20 листопада 2024 р. CONNECTED WORLD KSA

Час публікації: 19 лютого 2025 р.